OpenAi lancia due modelli open-weight e invade il campo di DeepSeek e Llama

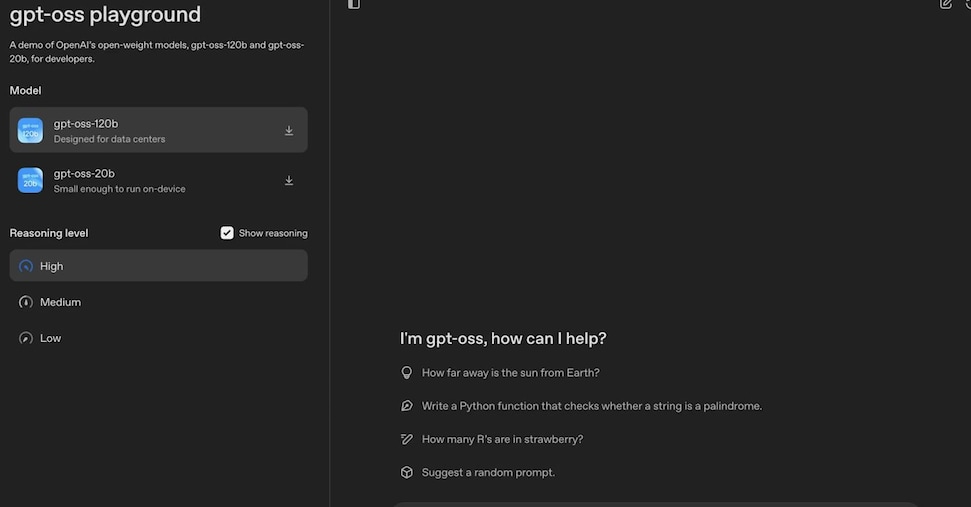

Quando era comparso sulla scena DeepSeek, il modello cinese aperto di Ai che fece sobbalzare tutta Wall Street, Sam Altman in un suo tweet si fece sfuggire che forse la scelta di ChatGpt come sistema chiuso era sbagliata. A distanza di alcuni mesi la scelta è stata quella di lanciare due modelli chiamati gpt-oss-120B e gpt-oss-20B. Si tratta di modelli di ragionamento open-weight che OpenAi definisce i più avanzati realizzati fino ad ora. Possono essere scaricati gratuitamente, addestrati e usati direttamente con le risorse hardware di un normale computer portatile. Non è ChatGpt 5 che verrà probabilmente rilasciato a breve ma un modello di intelligenza artificiale i cui pesi (cioè i parametri appresi durante l’addestramento) sono disponibili pubblicamente a differenza di ChatGpt, Gemini e Microsoft Copilot. L’altra caratteristica è che è un “reasoning model” e quindi per semplificare “riflette prima di rispondere. Il vantaggio è quello di offrire prestazioni reali elevate a basso costo. La sfida è quella di invadere il campo di Meta con Lllama, Google con Gemma e dei cinesi Deepseek e Qwen.

Come sono fatti?

Come si legge sul sito sono disponibili con la licenza flessibile Apache 2.0, questi modelli puntano a superare i modelli aperti di dimensioni simili nelle attività di ragionamento, dimostrano forti capacità di utilizzo degli strumenti e sono ottimizzati per un’implementazione efficiente su hardware consumer. Sono stati addestrati utilizzando un mix di apprendimento per rinforzo e tecniche informate dai modelli interni più avanzati di OpenAI, tra cui o3 e altri sistemi di frontiera.

Il modello gpt-oss-120b raggiunge quasi la parità con OpenAI o4-mini nei benchmark di ragionamento di base, mentre funziona in modo efficiente su una singola GPU da 80 GB. Il modello gpt-oss-20b offre risultati simili a OpenAI o3-mini su benchmark comuni e può essere eseguito su dispositivi edge con soli 16 GB di memoria. Quest’ultimo in particolare sembra pensato per girare anche con risorse hardware a disposizione sono limitate. In questo modo teoricamente posso essere utilizzati anche offline. Vengono così ridotte le barriere per sviluppatori, startup e organizzazioni che operano nei mercati emergenti o in ambienti ad alti livelli di sicurezza, permettendo loro di eseguire e personalizzare l’AI sulla propria infrastruttura.

OpenAI sta pubblicando nuove guide per sviluppatori e strumenti per aiutare i team a effettuare il fine-tuning in modo responsabile, implementare i guardrail e integrare i modelli con Hugging Face, vLLM, Ollama, llama.cpp e le principali piattaforme di GPU/accelerator.

I modelli open-weight verranno condivisi su Hugging Face e su altre piattaforme, con il report tecnico, il documento sulla sicurezza, la scheda di sistema e le guide per gli sviluppatori che saranno disponibili più tardi oggi.

Fonte: Il Sole 24 Ore